近日,信也科技攜手浙江大學(xué)合作的論文《Compositional Feature Augmentation for Unbiased Scene Graph Generation》成功獲得世界三大頂尖視覺會議之一ICCV 2023收錄。該論文首次提出了一種組合特征增強方法(Compositional Feature Augmentation,CFA),可以實現(xiàn)無偏的場景圖生成,可用于視覺問答、圖片檢索、圖片生成等大量下游任務(wù),在推薦、搜索、安防與風(fēng)險反欺詐等領(lǐng)域有著廣泛的應(yīng)用空間。

ICCV即國際計算機視覺大會(IEEE International Conference on Computer Vision),創(chuàng)辦于1987年,由美國電氣和電子工程師學(xué)會(IEEE)主辦,被中國計算機學(xué)會(CCF)推薦為人工智能領(lǐng)域A類會議,其論文集代表了計算機視覺領(lǐng)域最新的發(fā)展方向和水平。ICCV 2023將于2023年10月2日至6日在法國巴黎舉辦,本屆會議共收到投稿8060篇,接收2160篇,接收率約為26.8%。

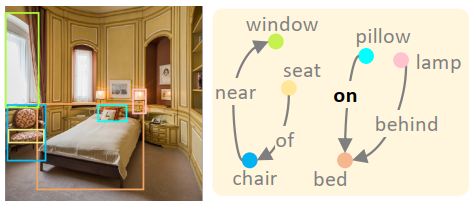

場景圖通常用于描述圖片中的物體、物體屬性和物體關(guān)系,對于理解圖片語義信息和控制生成圖片邏輯具有重要作用。然而,在不同的圖片數(shù)據(jù)中,物體之間的視覺關(guān)系出現(xiàn)的頻度差異巨大,具有顯著的長尾特征。這給場景圖生成的準(zhǔn)確性帶來了挑戰(zhàn),尤其是帶有低頻長尾關(guān)系的場景圖。

左側(cè)為圖片,右圖為相對應(yīng)的場景圖

為了克服這一難題,實現(xiàn)無偏的場景圖生成,該論文提出的CFA方法,提供了一個高效且具有創(chuàng)新性的組合學(xué)習(xí)框架,可以豐富長尾關(guān)系的特征空間,從而實現(xiàn)無偏的場景圖生成。而不僅僅像傳統(tǒng)的“再平衡”方法,只是增加已有樣本的權(quán)重。同時,CFA方法與模型無關(guān),僅在數(shù)據(jù)層面進行增強,因此具有廣泛的適用性。

該圖展示了兩個進行特征豐富的獨立模塊的原理,分別基于物體的內(nèi)在特征和物體之間的上下文關(guān)聯(lián),提高了場景圖生成的準(zhǔn)確性。

此次與浙江大學(xué)合作的論文,是信也科技在人工智能視覺知識化領(lǐng)域取得的重要突破。信也科技連續(xù)5年與浙江大學(xué)共建“浙江大學(xué)-信也科技人工智能聯(lián)合研發(fā)中心”,持續(xù)、多角度布局人工智能前沿科研領(lǐng)域,打造產(chǎn)學(xué)研融合通道,實現(xiàn)技術(shù)、人才與高校研究之間的有效聯(lián)動。

免責(zé)聲明:市場有風(fēng)險,選擇需謹(jǐn)慎!此文僅供參考,不作買賣依據(jù)。

恒大復(fù)牌股價跌近80%!半年

恒大復(fù)牌股價跌近80%!半年

美聯(lián)儲激進加息對A股和港股

美聯(lián)儲激進加息對A股和港股

鐵路暑運累計發(fā)送旅客超6億

鐵路暑運累計發(fā)送旅客超6億

階段性收緊IPO節(jié)奏 專家:

階段性收緊IPO節(jié)奏 專家:

“AI四小龍”上市之路各不相

“AI四小龍”上市之路各不相

深圳坪山新能源車產(chǎn)業(yè)園一期

深圳坪山新能源車產(chǎn)業(yè)園一期

48小時點擊排行

48小時點擊排行